No universo da Ciência de Dados e do Machine Learning, o K-NN (K-Nearest Neighbors) é um dos algoritmos mais simples e intuitivos — e, ao mesmo tempo, uma das técnicas que frequentemente aparece em provas de concursos públicos que cobram conhecimentos em estatística, mineração de dados e inteligência artificial. Seu entendimento é fundamental tanto para quem quer atuar na área prática, quanto para quem busca bons resultados em avaliações.

Leia o post até o final e fique por dentro de como o algoritmo K-NN é cobrado em concurso.

Conteúdo

O que é o K-NN?

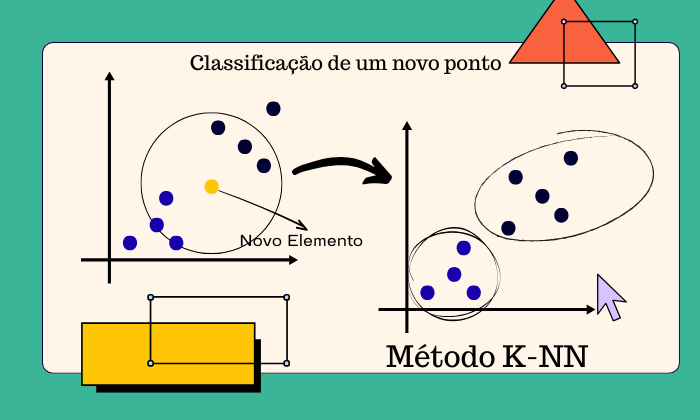

O K-Nearest Neighbors, traduzido como K Vizinhos Mais Próximos, é um algoritmo de aprendizado supervisionado utilizado para resolver problemas de classificação e regressão.

Ele se baseia em um princípio muito simples: objetos com características semelhantes tendem a pertencer à mesma categoria. Assim, para classificar um novo dado, o algoritmo verifica quais são os K exemplos mais próximos dele no conjunto de treinamento e utiliza as classes desses vizinhos para decidir a predição.

O “K” representa a quantidade de vizinhos a serem considerados. Por exemplo, se K = 3, o algoritmo analisará os 3 pontos mais próximos e escolherá a classe mais frequente entre eles (no caso de classificação) ou a média de seus valores (no caso de regressão).

Os melhores cursos de estatística para concurso:

- Estatística para Concurso.

- Matemática Essencial para Probabilidade e Estatística

- Probabilidade Essencial para Concurso;

- Inferência Essencial para Concurso;

- Distribuição Normal Essencial para Concursos;

- Teste de Hipóteses Essencial para Concurso;

Como o K-NN funciona na prática?

O funcionamento do K-NN pode ser resumido em quatro passos principais:

1. Escolher o valor de K

- Um K muito pequeno pode tornar o modelo sensível a ruídos e valores extremos (overfitting).

- Um K muito grande pode gerar resultados pouco precisos (underfitting).

2. Calcular a distância entre os pontos

- A métrica mais comum é a distância Euclidiana, mas outras como a distância de Manhattan ou Minkowski também podem ser utilizadas.

3. Identificar os K vizinhos mais próximos

- Selecionam-se os K registros do conjunto de treinamento que estão mais próximos do ponto a ser classificado.

4. Classificar ou prever o valor

- Classificação: escolhe-se a classe mais frequente entre os vizinhos.

- Regressão: calcula-se a média (ou mediana) dos valores dos vizinhos.

Aplicações do K-NN na Ciência de Dados

O K-NN é muito útil em cenários onde há necessidade de identificar padrões ou fazer previsões baseadas na proximidade de dados. Entre as aplicações práticas estão:

- Reconhecimento de padrões: como no reconhecimento facial ou identificação de escrita manual.

- Sistemas de recomendação: sugerindo produtos com base em clientes semelhantes.

- Detecção de anomalias: identificando transações financeiras suspeitas por meio da comparação com o comportamento de outros usuários.

- Classificação de documentos: categorização automática de textos ou e-mails.

Vantagens e Desvantagens

Vantagens:

- Simplicidade e fácil implementação.

- Não requer treinamento complexo — o algoritmo “aprende” diretamente a partir dos dados.

- Bom desempenho em datasets pequenos ou com fronteiras de decisão não lineares.

Desvantagens:

- Custo computacional alto para grandes volumes de dados, já que é necessário calcular distâncias para todos os pontos.

- Sensível a escalas diferentes nas variáveis, exigindo normalização ou padronização.

- Desempenho afetado por dados irrelevantes ou ruidosos.

O algoritmo K-Nearest Neighbors (K-Vizinhos Mais Próximos) é um método de aprendizado supervisionado amplamente usado para classificação e regressão. Ele funciona com base na similaridade entre amostras, medindo distâncias para determinar quais vizinhos influenciarão a predição.

K-NN em concursos públicos

Em provas de concursos para cargos de Cientista de Dados, Analista de TI, Estatístico ou Analista de Inteligência Artificial, o K-NN aparece frequentemente em questões teóricas e, às vezes, práticas. Os examinadores costumam explorar:

- Conceito e tipo de aprendizado (supervisionado).

- Diferença entre classificação e regressão no contexto do K-NN.

- Influência do valor de K no resultado.

- Cálculo de distâncias e interpretação de vizinhança.

- Impacto da normalização na performance do algoritmo.

Conclusão

O K-NN é um exemplo clássico de como uma técnica simples pode ser extremamente poderosa em Machine Learning e Ciência de Dados. Para concursos, compreender seu funcionamento, suas vantagens e limitações é essencial. Na prática, ele é útil em diversos contextos onde a similaridade entre observações é um fator decisivo.

Dominar o K-NN significa estar preparado tanto para resolver problemas reais de análise de dados quanto para responder com segurança às questões que surgirem na sua prova.

Deixe um comentário